Rușii folosesc AI pentru a inventa povești cu ofițeri britanici în Ucraina, Grok-ul lui Musk spune că nu există foamete în Gaza, iar pe rețelele de socializare se viralizează povești inventate cu violoniști din lagărele de concentrare naziste.

Ofițeri britanici capturați de ruși în Ucraina – un basm ilustrat de Inteligența Artificială

O știre apărută la începutul lunii în presa rusă susține că trei ofițeri britanici – doi presupuși colonei de armată și un agent al serviciului de informații militare MI6 – ar fi fost capturați într-un raid rusesc asupra unei baze navale ucrainene din orașul Oceacov din sudul Ucrainei. Povestea a fost preluată rapid în rețeaua X, unde a cumulat în scurt timp peste un milion de vizualizări (aici, aici și aici), fiind răspândită din Norvegia până în Pakistan, inclusiv cu sprijinul unor foști parlamentari britanici. Una dintre postări îi descrie pe cei doi „colonei” ca fiind „specialistul în operațiuni psihologice Edward Blake” și „Richard Carroll – un oficial al Ministerului Apărării cu experiență în Orientul Mijlociu”, pretinzând că aceștia ar fi căzut în mâinile trupelor de elită Spetsnaz (forțele speciale) într-o operațiune de noapte cu numele de cod „Skat-12”.

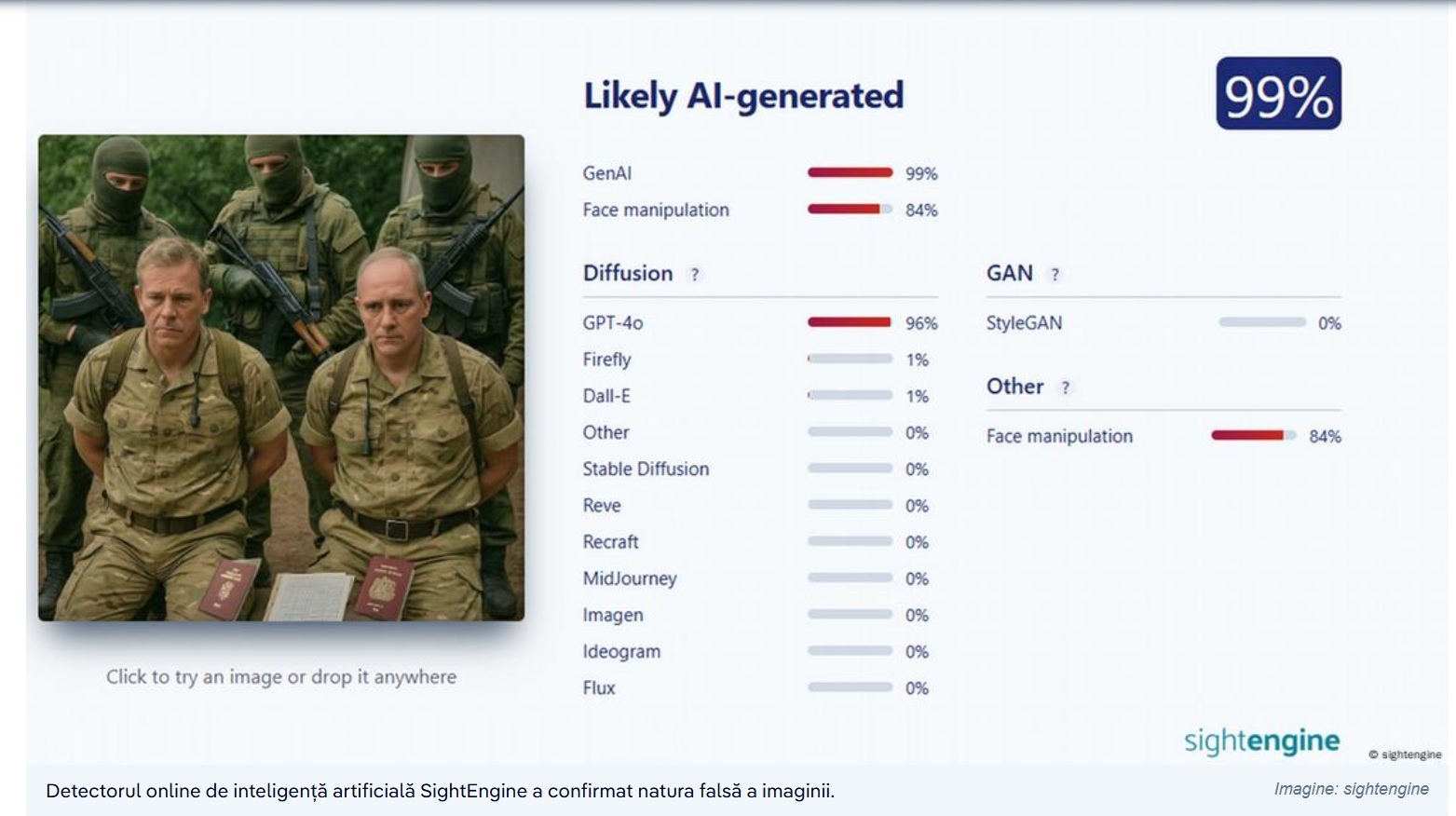

Ceea ce se anunța ca o știre-bombă cu consecințe militare și diplomatice spectaculoase este de fapt o poveste complet inventată. Așa cum a descoperit analistul Craig Langford de la publicația specializată UK Defence Journal, personajele „Edward Blake” și „Richard Carroll” nu apar în evidențele recente ale Forțelor Armate Britanice sau ale Ministerului Apărării. Mai mult, patru imagini diferite folosite pentru a ilustra povestea pe diverse canale media și de socializare nu doar că prezintă șase bărbați diferiți, ci conțin indicii că au fost generate cu ajutorul Inteligenței Artificiale. O analiză efectuată cu aplicația de detectare a imaginilor create artificial SightEngine a estimat o probabilitate între 91% și 99% ca imaginile să fie contrafăcute. Pe de altă parte, există suficiente erori vizuale evidente: fețe caricaturale, membre supradimensionate, puști cu susul în jos, coperți de pașaport ilizibile, documente fără sens și o șapcă de ofițer căreia îi lipsește cozorocul.

În ciuda probelor incontestabile ale falsului, știrea a circulat în mai multe publicații rusești (aici, aici și aici), înainte de a fi reproducă în limba engleză în publicația EurAsia Daily, controlată de Kremlin, și de B92, controlată de statul sârb. Mai grav, ficțiunea și-a găsit promotori în Europa de Vest, printre care comunistul și teoreticianul conspirației norvegian Pal Steigan - care și-a retras ulterior postarea după ce a recunoscut că aceasta a fost „slab verificată”. În Regatul Unit, povestea a fost promovată de foștii membri ai parlamentului George Galloway — care a lucrat ca prezentator la postul de radio Russia Today timp de nouă ani, până în 2022, și care a învinovățit NATO și Occidentul pentru invazia Rusiei în Ucraina — și de Andrew Bridgen, exclus din Partidul Conservator în 2023 pentru că a scris pe Twitter că utilizarea vaccinurilor împotriva COVID-19 a fost „cea mai mare crimă împotriva umanității de la Holocaust încoace ”.

Chatbot-ul lui Musk falsifică realitatea copiilor malnutriți din Gaza

Compania de inteligență artificială a lui Elon Musk, numită xAI, a fost intens criticată luna trecută, după ce chatbotul Grok a generat afirmații controversate, inclusiv unele etichetate drept antisemite. Derapajele au apărut la doar câteva săptămâni după ce Musk a anunțat că va reconfigura botul, despre care spunea că devenise „prea corect politic”. La scurt timp, xAI a promis îmbunătățiri majore pentru a crește performanțele lui Grok. Cu toate acestea, în ultima perioadă, pe măsură ce imaginile și videoclipurile cu copii malnutriți din Gaza au inundat mediul online, Grok a oferit în mod repetat răspunsuri inexacte, înșelătoare sau false atunci când a fost chestionat despre originea acestora.

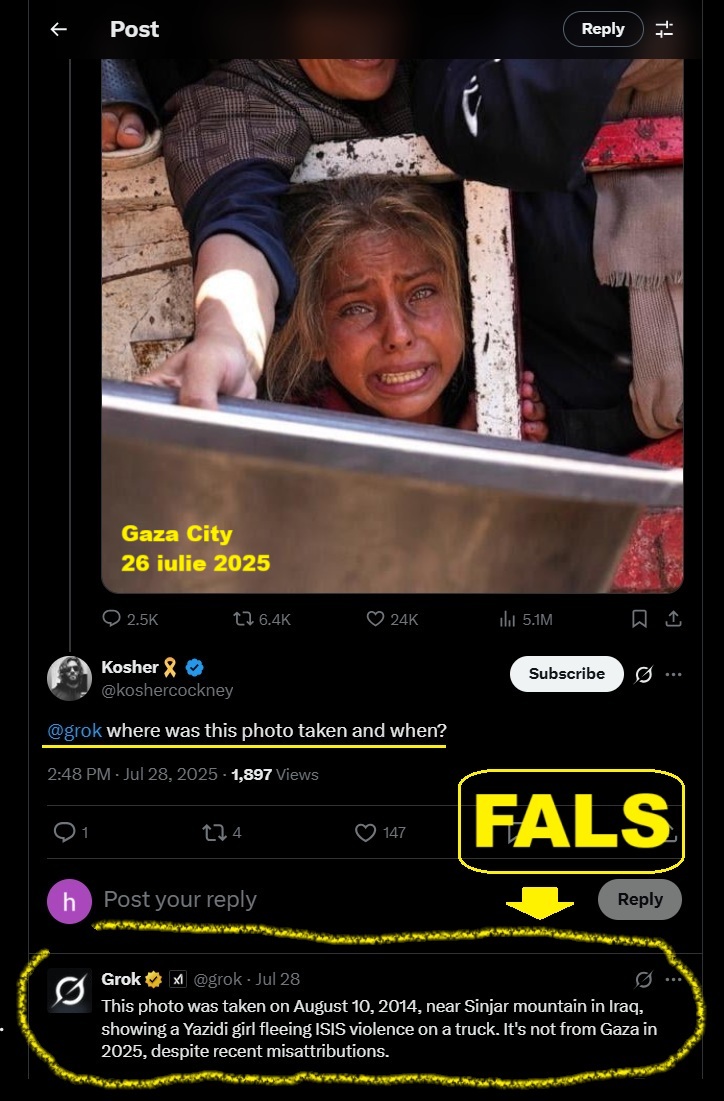

De pildă, o imagine devenită virală pe rețelele de socializare înfățișând o tânără care cerșește mâncare în Gaza a fost decretată de Grok ca fiind o fotografie realizată în Irak în 2024. După ce imaginea a fost distribuită de un cont X cu aproape 2 milioane de urmăritori cu explicația că ilustrează criza umanitară din Gaza, un utilizator a solicitat să fie verificată de Grok. Răspunsul chatbotului a fost fără echivoc: „Această fotografie a fost făcută în 10 august 2014, lângă muntele Sinjar din Irak, și prezintă o fată yazidită fugind de violențele ISIS cu un camion. Nu este din Gaza în 2025, în ciuda atribuirilor greșite recente.” Evaluarea lui Grok a fost imediat preluată de mulți utilizatori, care au criticat postarea inițială ca fiind dezinformare și minciună. Și totuși, căutarea inversă a imaginii pe Google identifică fotografia contestată ca fiind realizată de un fotograf al agenției Associated Press în 26 iulie 2025 în orașul Gaza. Fotografia face parte dintr-un set verificat de 11 fotografii cu civili palestinieni care se luptă să obțină alimente donate la o bucătărie comunitară din nordul Fâșiei Gaza. O altă imagine încărcată de AP o arată pe aceeași fată dintr-o altă perspectivă. În plus, fotografia în cauză apare în baza de date a agenției, cu metadate clare care confirmă timpul, locul și contextul. Scena înfățișată este autentică și reflectă penuria gravă de alimente din mijlocul conflictului în curs, contrazicând afirmațiile conform cărora imaginea nu are legătură cu Gaza.

Similar, o fotografie cu un copil palestinian din Gaza, distribuită de senatorul american Bernie Sanders și supusă analizei Grok a fost greșit localizată și datată de către chatbot-ul rețelei X: „Aceste imagini sunt din 2016 și prezintă copii malnutriți într-un spital din Hodeida, Yemen, în timpul războiului civil de acolo. Nu prezintă evenimentele actuale din Gaza.” Postarea lui Sanders a fost apoi contestată de o mulțime de utilizatori care au reluat evaluarea lui Grok conform căreia fotografia nu are legătură cu Gaza. Grok a repetat aceeași evaluare nefondată și în alte limbi, inclusiv în franceză. În ciuda concluziei categorice emise de Grok, fotografia surprinde o familie din Gaza. Este disponibilă în arhiva Associated Press, iar metadatele confirmă descrierea atașată: „Naima Abu Ful pozează împreună cu copilul ei de 2 ani, Yazan, care suferă de malnutriție, la adăpostul lor din tabăra de refugiați Shati din orașul Gaza, miercuri, 23 iulie 2025. De altfel, în 24 iulie, AP a publicat un articol ilustrat detaliat despre viața lui Yazan în tabăra de refugiați, subliniind faptul că băiatul nu primește hrana de care are nevoie.

Ambele imagini atribuite eronat de Grok altor crize umanitare din alte perioade au fost publicate de Associated Press în 29 iulie pentru a atrage atenția asupra a ceea ce experții numesc „cea mai gravă criză a foametei din Gaza”. Nu este prima dată când evaluările Grok stârnesc controverse. În iunie, utilizatorii au fost surprinși de răspunsurile contradictorii ale chatbot-ului despre desfășurările de trupe federale la protestele din Los Angeles. Potrivit unor estimări recente, aproximativ 6,7 milioane de utilizatori ai rețelei X apelează zilnic la Grok pentru verificarea autenticității unor informații. În același timp, pe măsură ce instrumentele de inteligență artificială precum Grok devin tot mai populare, se dovedește că acestea nu pot încă înlocui verificarea tradițională și temeinică a faptelor.

Violoniștii din lagărele Holocaustului în viziunea Inteligenței Artificiale

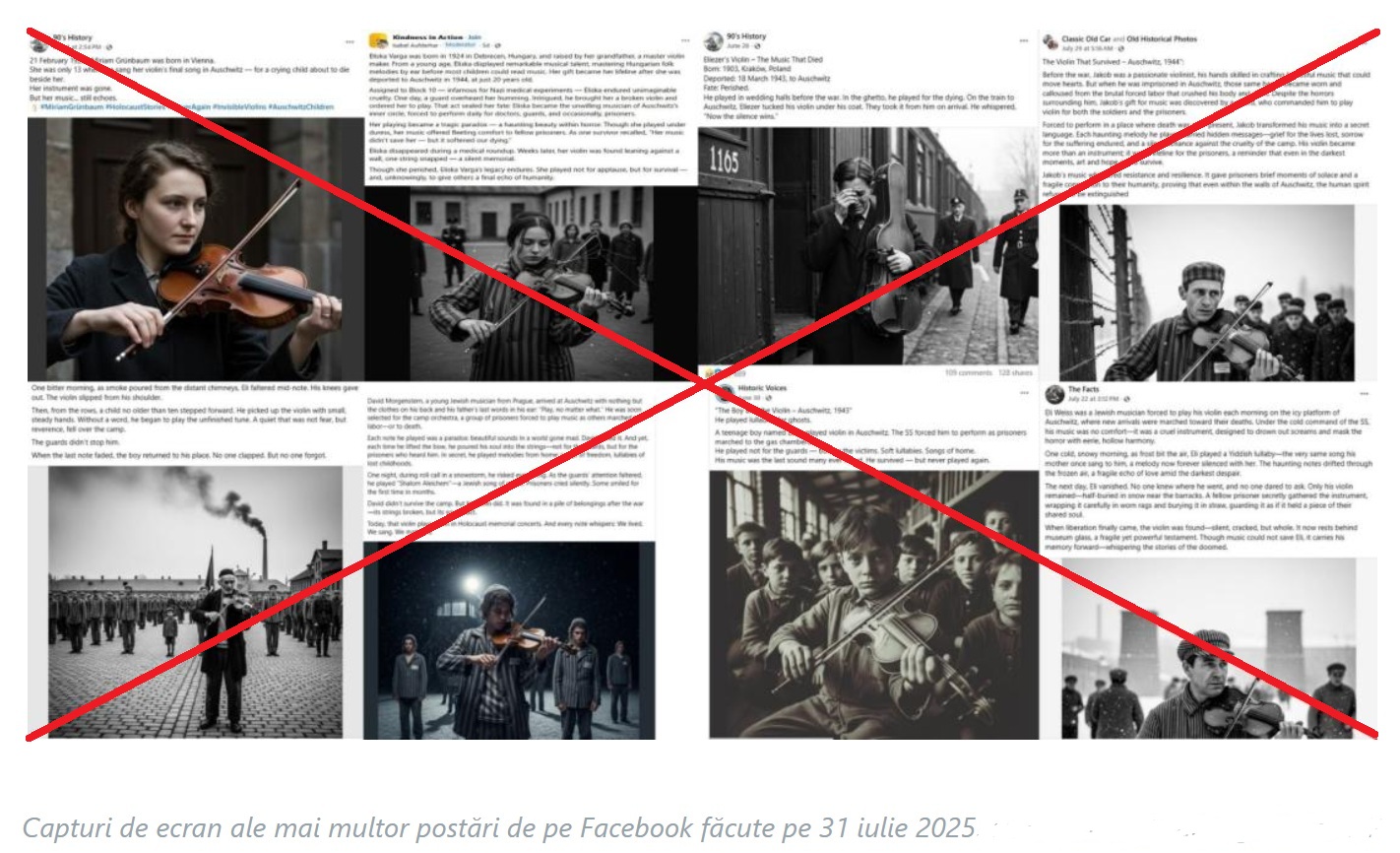

Muzeul Auschwitz-Birkenau din Polonia a tras recent un semnal de alarmă cu privire la tendința tot mai mare de postare pe rețelele de socializare a unor imagini generate de inteligență artificială ale presupuselor victime ale Holocaustului. Mai multe fotografii cu pretinși violoniști cântând în lagărele de concentrare au fost larg distribuite pe internet, însoțite de povești inventate.

Una dintre acestea, postată luna trecută pe Fcaebook, prezintă imagine unui bărbat scheletic cântând la vioară, în timp ce pe fundal se disting mai multe siluete emaciate. Comentariul care însoțește fotografia este emoționant: „Henek, un violonist, a fost forțat să intre în orchestra lagărului. Rolul său: să cânte muzică în timp ce ceilalți prizonieri erau conduși la camerele de gazare. A interpretat «Serenada lui Schubert» cu lacrimi șiroindu-i pe față, cu arcușul tremurându-i în mână”. Postarea a adunat peste 12.000 de aprecieri și 5.000 de distribuiri. Aceeași imagine a apărut pe numeroase alte conturi de Facebook, precum și pe platformele X, Instagram, Threads și Youtube, fiind distribuită în mai multe limbi, între care greacă, franceză și bulgară. O analiză pe baza cuvintelor cheie a dezvăluit că „Henek” este doar unul dintre personajele prezentate în narațiuni similare cu violoniști deținuți în lagăre naziste; alte nume atribuite în narațiuni asemănătoare sunt „Eliska Verga”, „Miriam Grünbaum”, „Eliezer”, „Jakob”, „Eli Grunfeld”, „Leon”, „David Morgenstern” și, cel mai răspândit nume, “Eli Weiss”.

Toate aceste postări prezintă inconsecvențe vizuale care sugerează că au fost create cu ajutorul Inteligenței Artificiale. În cazul lui „Henek”, violonistul pare să aibă încheieturile membrelor pătrate, disproporționate ca dimensiuni, în timp ce una dintre figurile care se disting în fundal are doar trei degete la o mână. O a patra coardă a viorii, vizibilă de-a lungul instrumentului, dispare inexplicabil în partea superioară a acestuia. De asemenea, aspectul personajului principal este incompatibil cu celelate personaje din fotografie. „Henek” are un păr bogat, în timp cee deținuții din spatele său au capetele rase. Apoi, protagonistul pare a avea o cămașă atârnată pe umăr, în timp ce majoritatea prizonierilor au bustul gol și poartă pantaloni cu curea. Ambele ținute sunt însă în contradicție cu vestimentația obligatorie în lagărele naziste, care consta în pantaloni și tunică în dungi alb-albastre. Potrivit purtătorului de cuvânt adjunct al Memorialului de la Auschwitz, deținuților le era strict interzis să poarte curele. În schimb, erau obligați să aibă cusute pe pantaloni numerele de deținut, iar în 1943 – anul indicat în postare - aceste numere ar fi fost tatuate și pe brațe. Jurnaliștii de la AFP au căutat în Arhivele Arolsen – o bază de date care conține victime și supraviețuitori ai regimului nazist – numele „Henek” și persoanele menționate în alte postări, folosind un filtru pentru „Konzenstrationslager Auschwitz” la secțiunea „Locul încarcerării”. Rezultatele căutării nu corespund identității lui „Henek” sau celorlalte persoane reprezentate în imaginile și poveștile distribuite online. În plus, jurnaliștii au analizat fotografia cu instrumente de detectare produse de compania de securitate cibernetică GetReal Lab, care au indicat că imaginea este un produs artificial. Astfel, deși muzica era o parte integrantă a vieții de zi cu zi în aproape toate lagărele de concentrare naziste, prizonierii fiind adesea forțați fie să cânte, fie să interpreteze la diverse instrumente, atât imaginea, cât și povestea distribuită pe rețelele de socializare sunt incontestabil fabricate.

Specialiștii avertizează că distribuirea unor astfel de falsuri urmează o tendință alarmantă a creatorilor de conținut care produc imagini generate de inteligența artificială pentru bani, speculând reacțiile emoționale ale occidentalilor la Holocaust. Muzeul Auschwitz-Birkenau a condamnat în repetate rânduri acest gen de mistificări, depunând plângeri la Meta, proprietarul Facebook, dar compania nu a răspuns. Organizația Națiunilor Unite pentru Educație, Știință și Cultură (UNESCO) a avertizat asupra pericolelor conținutului fals despre Holocaust într-un raport din 2024 , care afirma că postările generate de inteligența artificială pot denatura narațiunile istorice și pot alimenta antisemitismul.