Un raport-cheie al guvernului american, redactat cu ajutorul instrumentelor AI, e împănat de erori. În Franța, în schimb, conspiraționiștii văd mâna AI și acolo unde aceasta nu există.

Breaking Fake News realizează, săptămânal, o selecție a narațiunilor false demontate în presa internațională.

Un raport al administraţiei Trump citează studii ştiinţifice inventate

Mult aşteptatul raport al administraţiei Trump privind sănătatea copiilor americani a fost extrem de mediatizat, dar nu în sensul dorit de autorii săi. Lansat în 22 mai cu pretenţia unui document fundamental de către comisia prezidenţială „Să facem America sănătoasă din nou” – botezată după sloganul „Make America Healthy Again” al controversatului secretar pentru sănătate Robert F. Kennedy Jr. – raportul a ajuns să pună sub semnul întrebării nu doar competenţele, ci şi buna-credinţă a celor care l-au redactat. Şi asta pentru că între cele aproximativ 500 de lucrări ştiinţifice citate ca argumente s-au strecurat mai multe studii inexistente. Primele erori au fost semnalate în 29 mai de jurnaliştii site-ului de ştiri Notus, care au depistat nu mai puţin de şapte studii fictive menţionate în notele de subsol ale raportului, pe lângă linkuri nefuncţionale şi concluzii greşite. Ulterior, jurnaliştii altor publicaţii au descoperit erori similare, confirmate de presupuşii autori citaţi. De pildă, Noah Kreski, un cercetător de la Universitatea Columbia, autor al unei lucrări despre anxietatea și depresia adolescenților în timpul pandemiei de Covid-19, a declarat pentru AFP că lucrarea care îi este atribuită în raport „nu este unul dintre studiile sale”, adăugând că i se pare mai degrabă „un studiu inexistent”. Citarea includea şi un link defect care pretindea că trimite cititorii la un articol din revista medicală JAMA Pediatrics. Conducerea revistei a negat că ar fi publicat studiul indicat în raport. Similar, epidemiologul Katherine Keyes, menţionată şi ea ca autoare a presupusului studiu, a afirmat că statisticile cuprinse în raport nu au legătură cu activitatea sa sau cu lucrări de care să aibă ştiinţă. Guohua Li, şi el profesor la Columbia menţionat în citare, a declarat că referinţa este „total fabricată” şi că nici măcar nu-l cunoaşte pe cercetătorul Kreski. Jurnaliştii au vorbit şi cu Harold Farber, profesor la Baylor College of Medicine, care a spus că lucrarea care i-a fost atribuită „nu există” şi a negat că ar fi colaborat vreodată cu coautorii menţionaţi în raport. Totodată, Brian McNeill, purtător de cuvânt al Universităţii Virginia Commonwealth, a infirmat că profesorul Robert Finding ar fi autorul unei lucrări despre publicitatea medicamentelor psihotrope pentru tineri, aşa cum apare în raportul comisiei prezidenţiale. O a patra lucrare despre medicaţia ADHD nu a fost niciodată publicată în revista de specialitate Pediatrics, potrivit editorului revistei, Academia Americană de Pediatrie. Secretarul de presă al Casei Albe, Karoline Leavitt, a minimalizat erorile într-o conferinţă de presă, punându-le pe seama unei banale probleme tehnice.

Karoline Leavitt, secretar de presă Casa Albă:

„Avem deplină încredere în secretarul Kennedy şi echipa lui de la Departamentul Sănătăţii. Înţeleg că au fost nişte probleme de formatarea raportului MAHA, care vor fi corectate în varianta actualizată. Aceasta nu anulează însă substanţa raportului, care, aşa cum ştiţi, este unul dintre cele mai revoluţionare rapoarte despre Sănătate publicat vreodată de un guvern federal şi se bazează pe date ştiinţifice solide care nu au fost niciodată cunoscute de vreun guvern.”

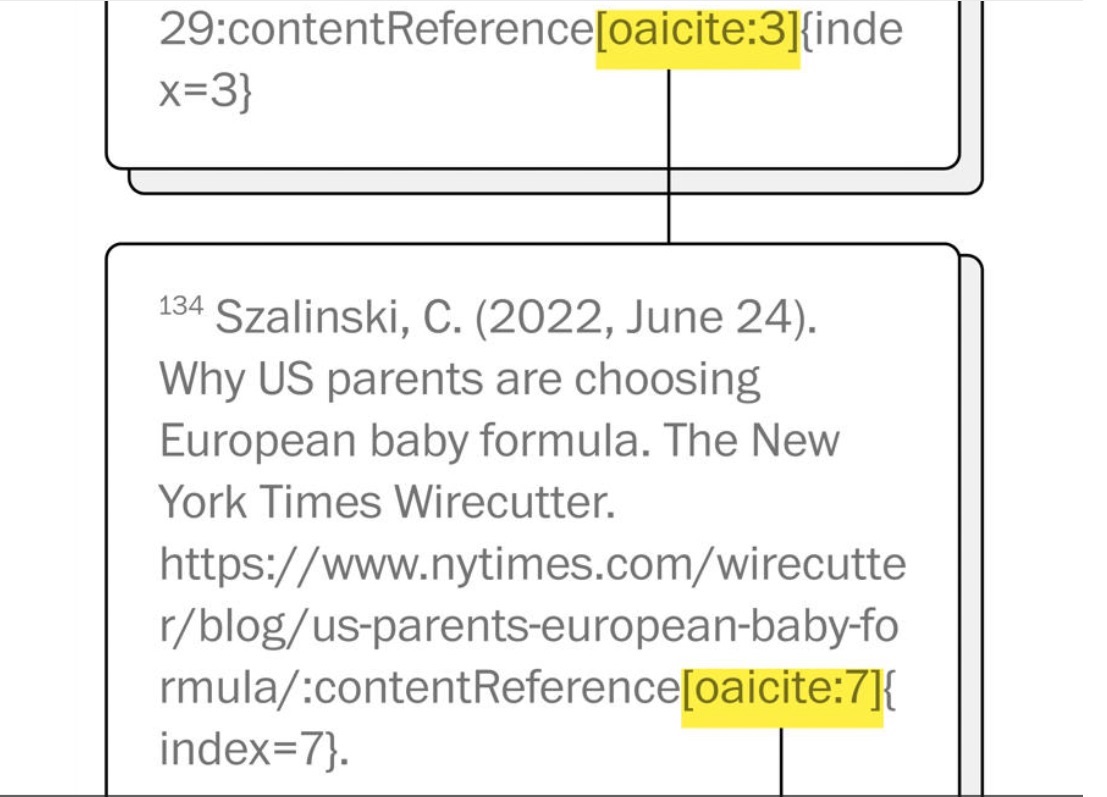

Justificarea erorilor de citare prin invocarea unor scăpări tehnice minore în pregătirea textului raportului nu poate fi luată în serios. În schimp, este plauzibilă varianta oferită de experţii consultaţi de cotidianul The Washington Post, care spun că datele ştiinţifice din documentul oficial par să fi fost afectate de folosirea Inteligenţei Artificiale. Au rezultat astfel numerose referinţe denaturate şi studii inventate. Unele referinţe au ataşată la adresa web formula „oaicite”, un semn distinctiv că cercetarea a fost colectată folosind Inteligenţa Artificială. „Oaicite” este un marker care indică utilizarea instrumentelor OpenAI, o companie americană de inteligenţă artificială. Una dintre caracteristicile comune ale chatboţilor cu inteligenţă artificială, precum ChatGPT, este conţinutul neobişnuit de repetitiv care nu sună uman sau este inexact, precum şi tendinţa de a crea studii sau răspunsuri care par să aibă sens, dar nu sunt reale.

După dezvăluirile din presă, autorii raportului au corectat sau înlocuit complet cel puţin 18 citări eronate din raportul original. Totuşi, specialiştii au semnalat că, în ciuda modificărilor, câteva dintre noile citări actualizate continuă să interpreteze greşit studiile ştiinţifice.

Scandalul dezinformărilor din raportul privind cauzele deteriorării stării de sănătate în Statele Unite a izbucnit la doar o zi după ce Robert F. Kennedy Jr a atacat reviste medicale americane importante, acuzându-le de colaborare cu industria farmaceutică şi ameninţând oamenii de ştiinţă din instituţiile guvernamentale că le va interzice să publice în acestea. Kennedy a fost confirmat în funcţia de secretar al Sănătăţii la începutul anului, în ciuda îngrijorărilor exprimate de comunitatea medicală cu privire la antecedentele sale de promotor al dezinformărilor despre vaccinuri şi de negaţionist al unor fapte dovedite ştiinţific.

Când Inteligenţa Artificială este păcălită de realitate

Mai mulți utilizatori ai rețelelor de socializare l-au acuzat pe politicianul francez de extremă stânga Jean-Luc Mélenchon că a postat o fotografie modificată digital de la un protest împotriva islamofobiei organizat în 11 mai la Paris de formaţiunea La France Insoumise / Franţa nesupusă. Reproşul avea în vedere numărul de drapele prezente în imagine, considerat neverosimil de mare.

Titularul contului din reţeaua X botezat „Le Lapin du Futur” (Iepurele Viitorului) se arăta dispus să parieze 100 de euro că politcianul francez a folosit Inteligenţa Artificială pentru a spori numărul real de drapele naţionale. Într-una dintre fotografiile postate de Mélenchon, acesta apare în prima linie a manifestaţiei, în timp ce în spate mii de protestatari flutură diverse steaguri, de la cel francez la cel palestinian şi cel al partidului. Postarea lui Lapin du Futur a adunat două milioane de vizualizări, acuzaţia fiind preluată şi de alţi utilizatori. Unul dintre aceştia a mers şi mai departe, susţinând că niciunul dintre drapelele Franţei etalate în imagine nu este real. Postarea sa a depăşit 700.000 de vizualizări. Unii internauţi au subliniat anumite detalii din fotografie care indică adesea că o imagine a fost generată de inteligența artificială, cum ar fi mâinile oamenilor care arată în mod ciudat sau par deformate. În cazul unei fotografii, un protestatar care ține un steag pare să aibă doar patru degete, în timp ce mâna altei persoane are, în aparenţă, șase degete.

Un utilizator a distribuit capturi de ecran de la instrumentul Sightenigine de detectare a urmelor folosirii inteligenței artificiale, care a stabilit că există o probabilitate de 90% ca imaginea să fi fost generată artificial. Un alt instrument, Decopy AI, a indicat o probabilitate de 95% ca fotografia să fie falsificată. Şi totuși, fotografia în discuţie nu a fost generată de inteligența artificială, iar niciunul dintre elementele din imagine nu a fost adăugat ulterior. Mai mulţi internauţi – deputaţi ai partidului lui Mélenchon sau simpatizanţi ai acestuia – au postat pe reţelele de socializare fotografii de la acelaşi eveniment, din diverse unghiuri şi la momente diferite. În toate apar şi pe pagina de YouTube a Agenţiei France Presse. Pe de altă parte, o analiză atentă a mâinilor care par să aibă patru sau şase degete arată că toate au, în realitate, cinci degete: presupusul deget lipsă al mâinii care ţine steagul este de fapt parţial ascuns de catarg, iar ceea ce pare a fi un al șaselea deget este de fapt un efect creat de unghiul braţului și de umbra proiectată pe încheietura mâinii persoanei.

Partidul La France Insoumise, care a negat categoric folosirea Inteligenţei Artificiale pentru modificarea fotografiilor, a precizat pentru France24 că fotografiile au suferit corecţii elementare în procesul de editare, fiind mărit contrastul, redusă luminozitatea şi accentuată intensitatea culorilor. Se pare că intervenţiile minore de acest gen pot deruta unele instrumente menite să detecteze imaginile generate de inteligența artificială. Partidul lui Mélenchon le-a trimis jurnaliştilor imaginea originală, fără nicio modificare a contrastului sau a culorilor. Supusă verificării cu instrumentul Sightengine, acesta nu a detectat nicio posibilă utilizare a inteligenței artificiale. Constatarea susține teoria conform concluzia iniţială că fotografia a fost generată artificial a fost influenţată de banalele corecții de culoare și contrast, cu menţiunea că astăzi există inteligenţă artificială în aproape toate instrumentele de editare foto.